大家好,我是二哥呀。

很多小伙伴把 Skills 当成“高级 Prompt”来用,但实际上它的价值远不止于此。

我花了一周时间,实测了 20 多个热门 Skills,最后筛选出 6 个真正好用的。

更重要的是,这些 Skills 不是只能用在 Claude Code 中——Codex、TRAE、Qoder 也能用,真正做到一次配置,到处运行。

如果你想知道哪些 Skills 值得装、怎么让它们在不同工具间共享、以及怎么把这段经历写到简历上,这篇文章会给你一个完整的答案。

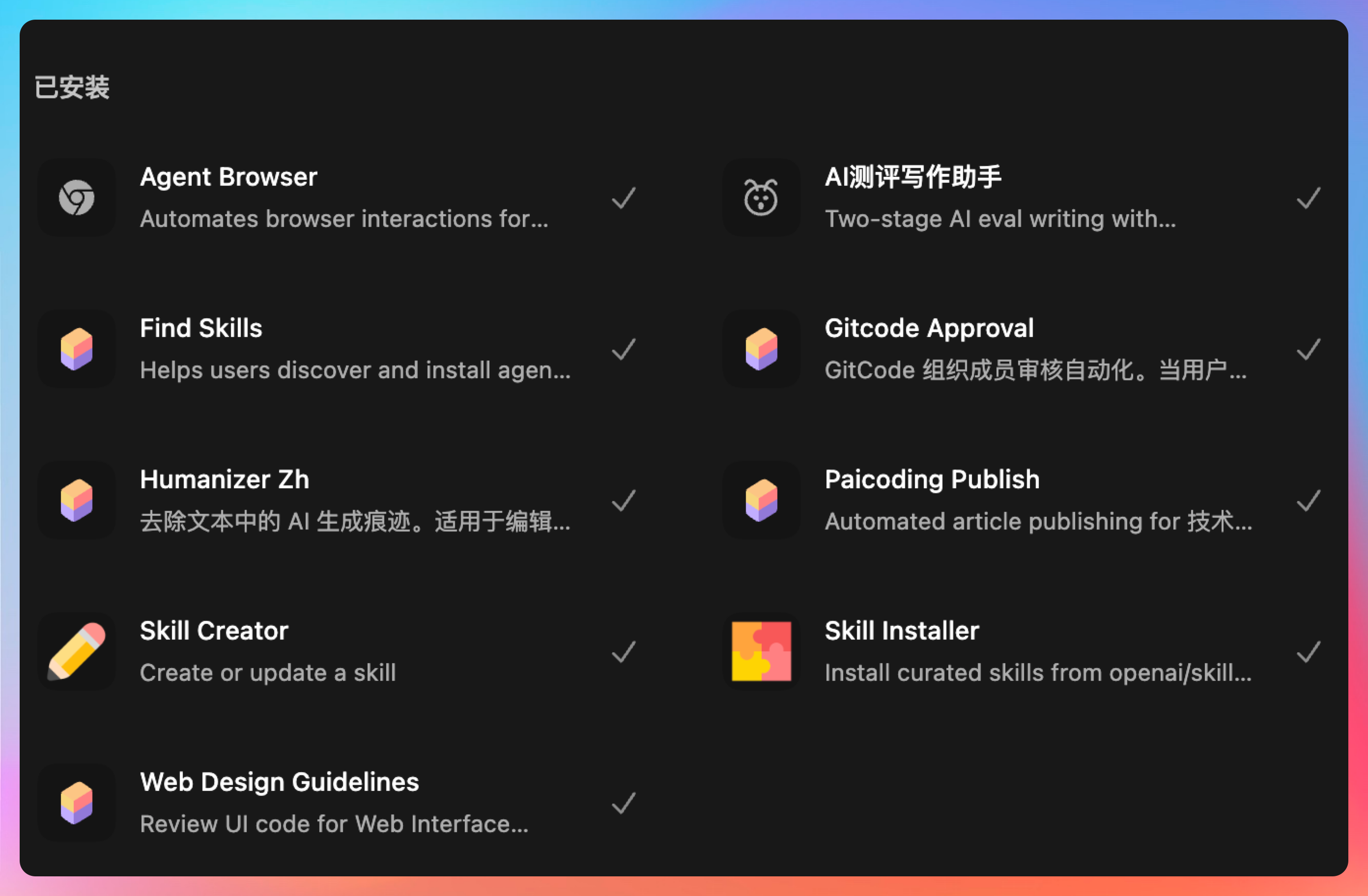

01、6 个 Skills 实测推荐

先上干货,这 6 个 Skills 是我筛选后留下的。

Frontend-design(前端设计)

下载地址:https://mcpservers.org/claude-skills/anthropic/frontend-design

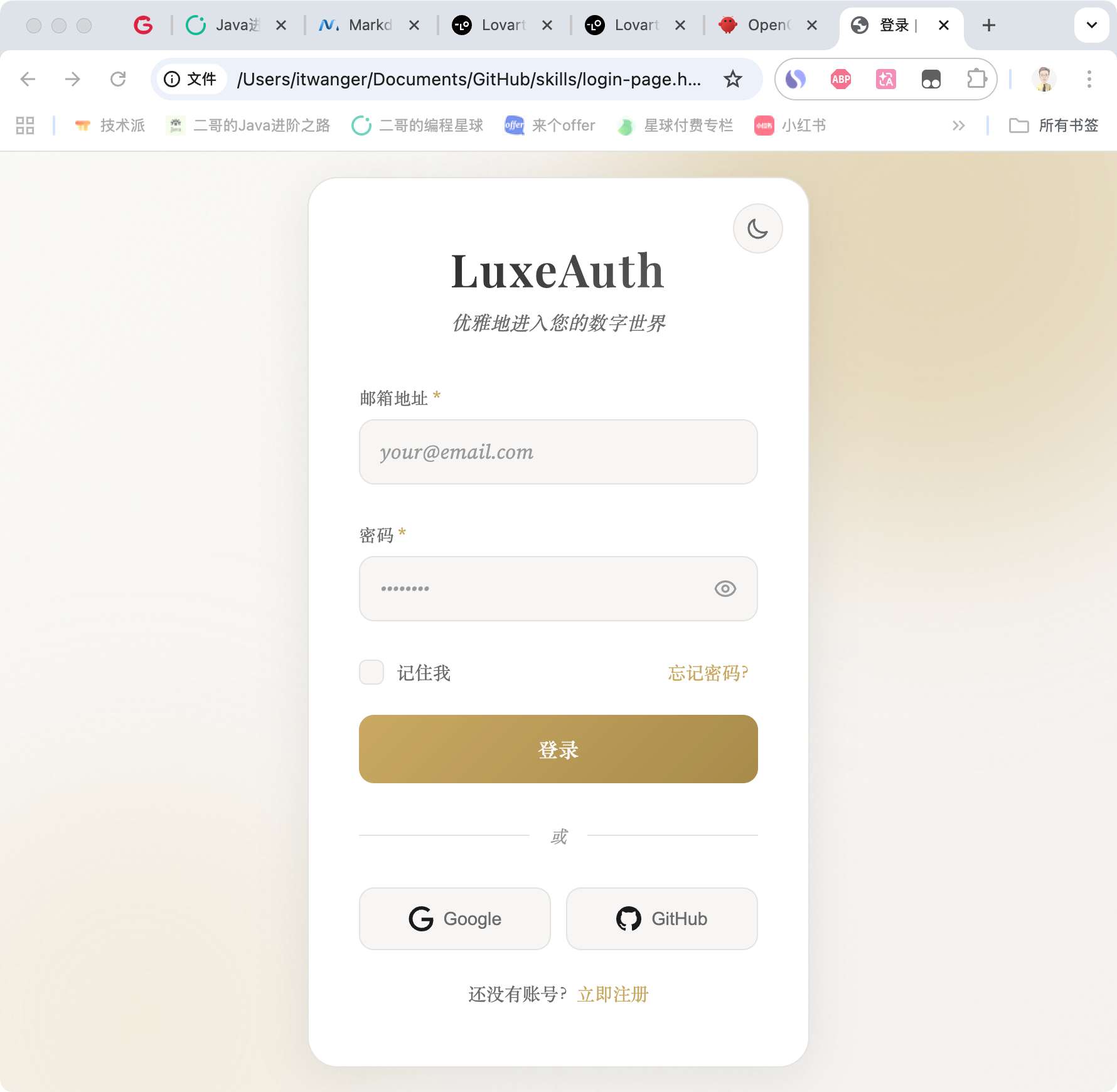

这个 Skill 的定位是“前端设计专家”。你描述需求,它直接输出 HTML+CSS 代码,带响应式布局。

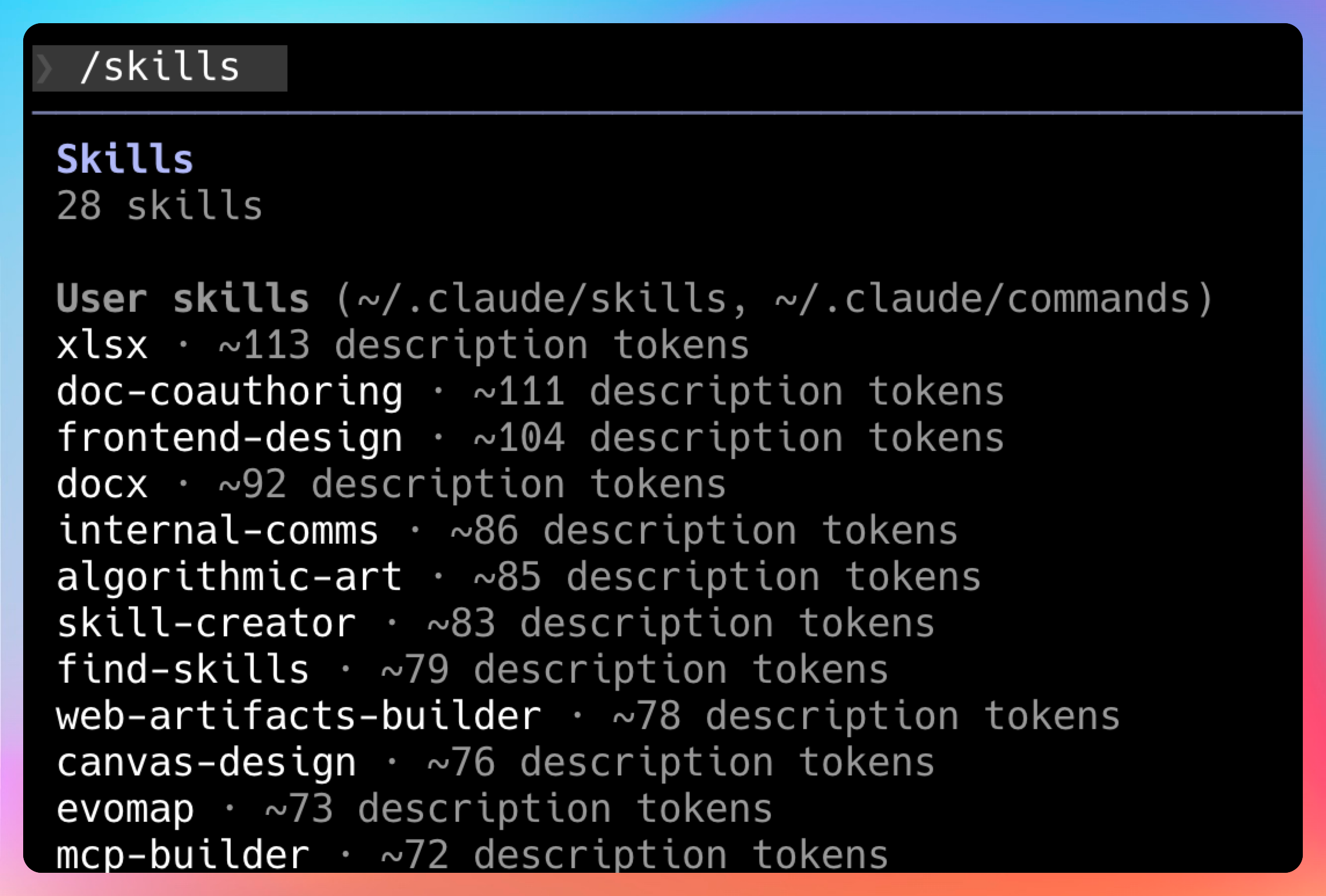

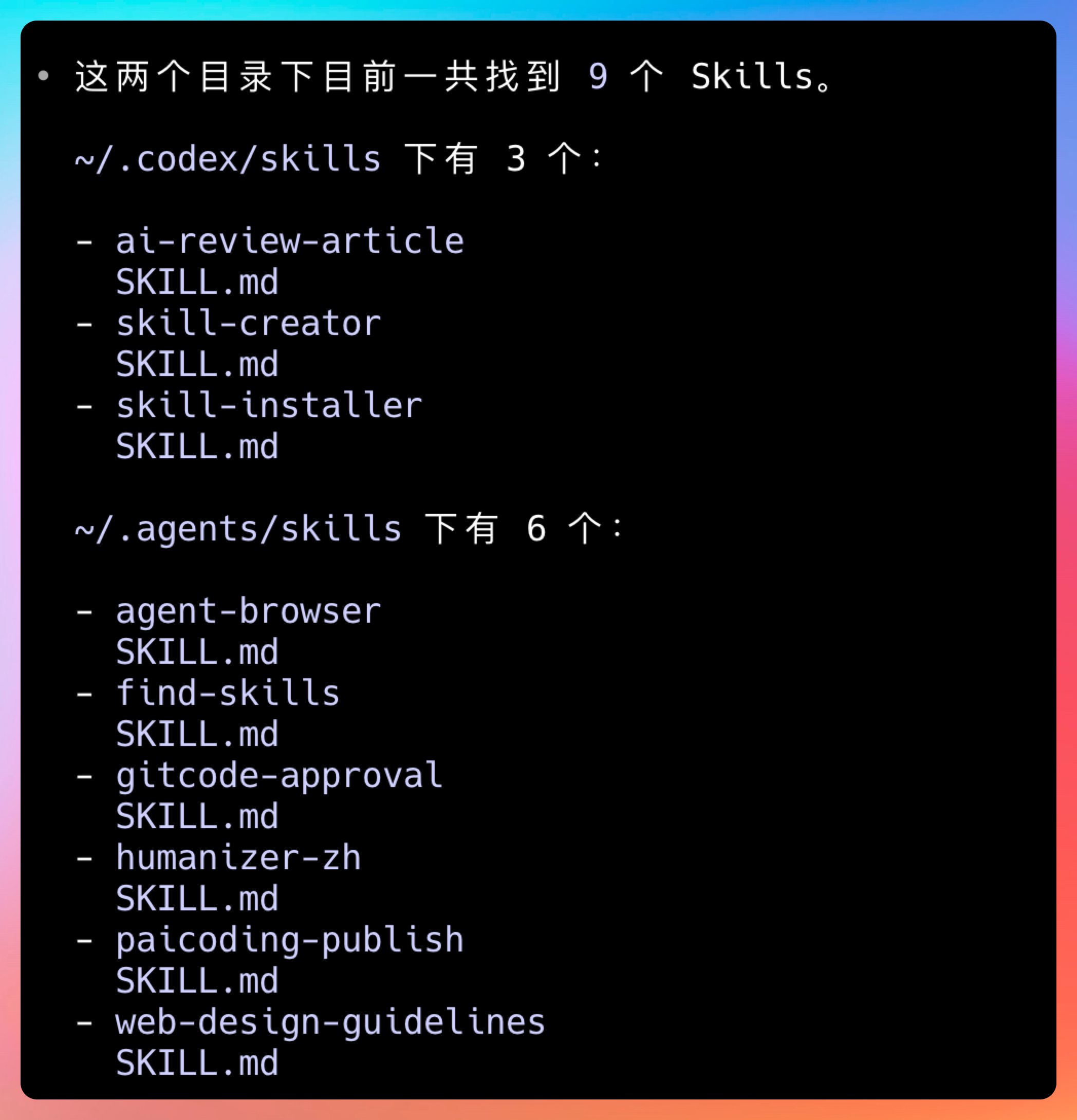

想要看 Claude Code / Codex 中都安装了哪些Skills?可以执行 /skills 命令。

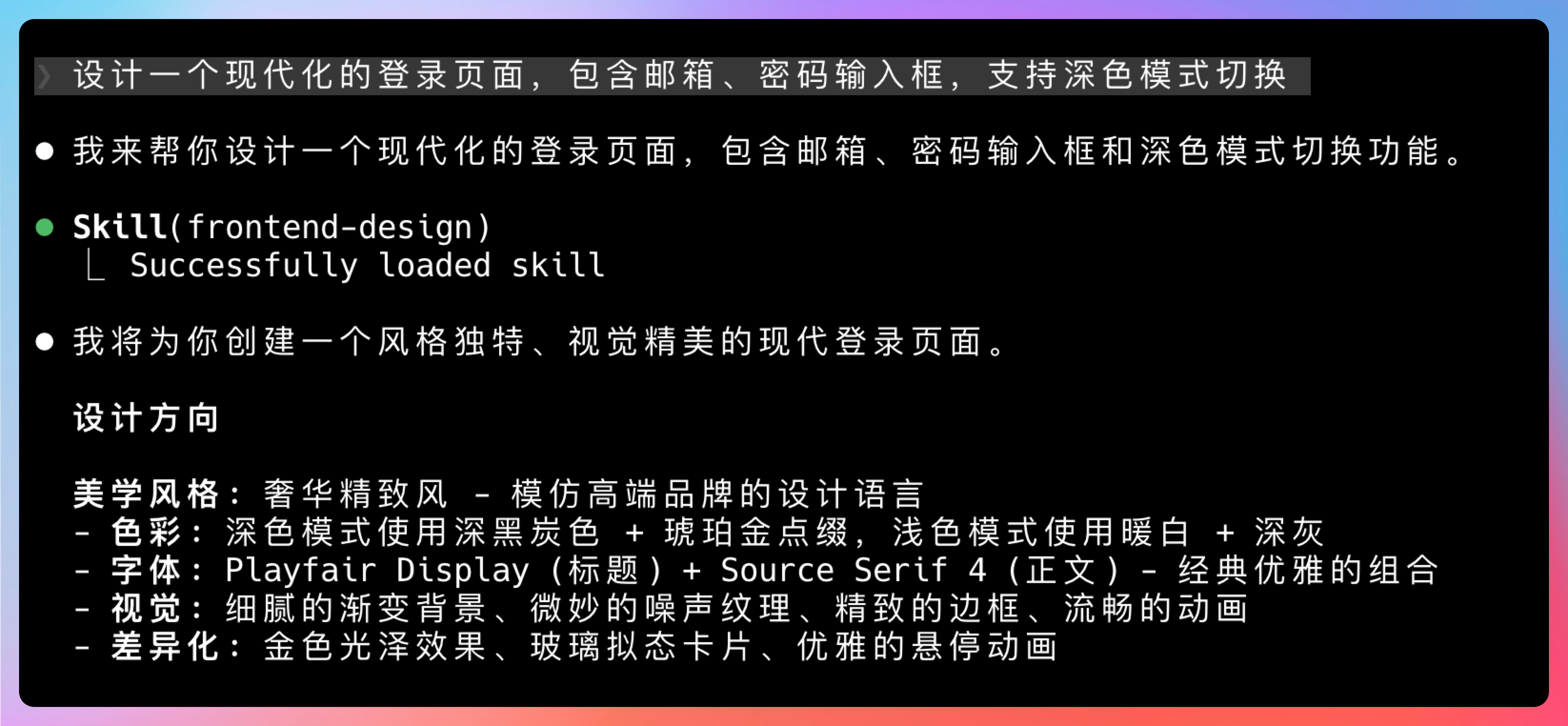

我测试了一个登录页的需求:“设计一个现代化的登录页面,包含邮箱、密码输入框,支持深色模式切换”。

- 色彩: 深色模式使用深黑炭色 + 琥珀金点缀,浅色模式使用暖白 + 深灰

- 字体: Playfair Display (标题) + Source Serif 4 (正文) - 经典优雅的组合

- 视觉: 细腻的渐变背景、微妙的噪声纹理、精致的边框、流畅的动画

- 差异化: 金色光泽效果、玻璃拟态卡片、优雅的悬停动画

当然了,这和背后的模型有一定的关系,我目前用的是GLM-5做的测试。

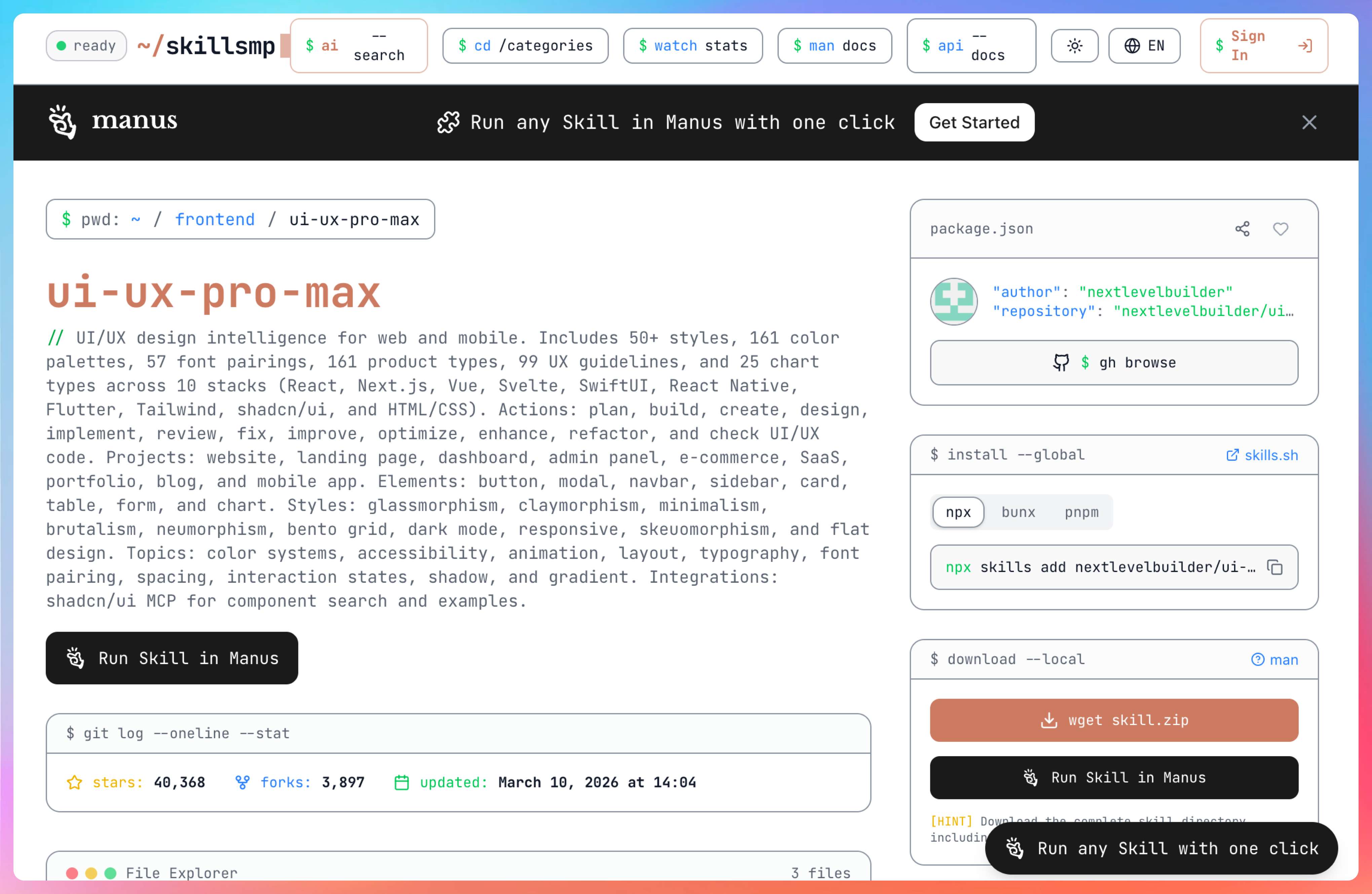

UI-UX-PRO-MAX

这个 Skill 比 Frontend-design 更侧重 UX 流程。它不会直接给你代码,而是先出线框图描述、交互流程、再出视觉方案。

同样是登录页需求,它的输出是:用户流程图 → 信息架构 → 线框图描述 → 视觉建议。适合需要完整设计文档的场景,但如果你只想快速拿到代码,会觉得它“太啰嗦”。

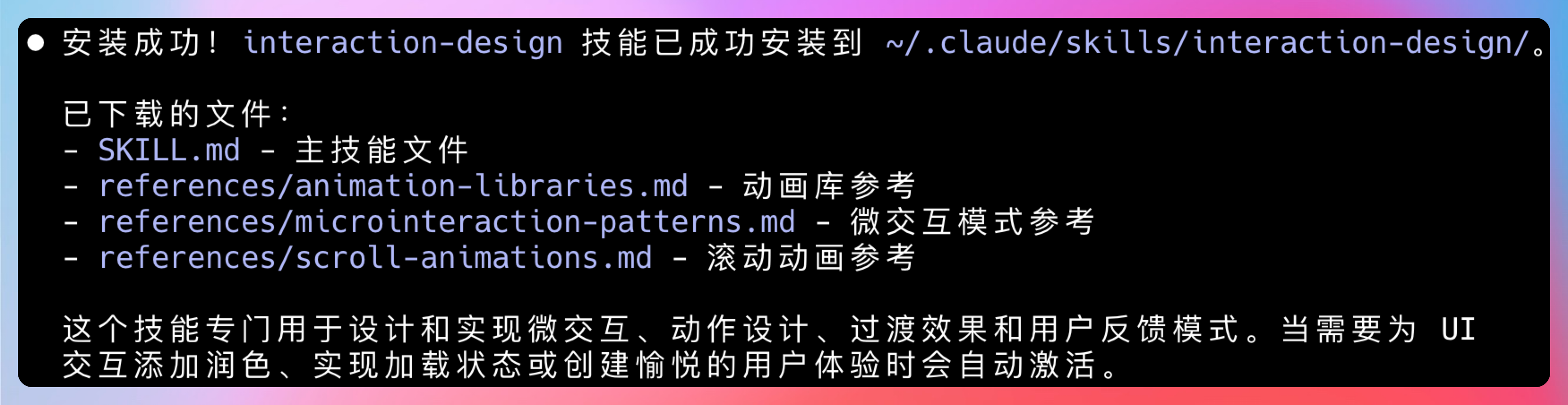

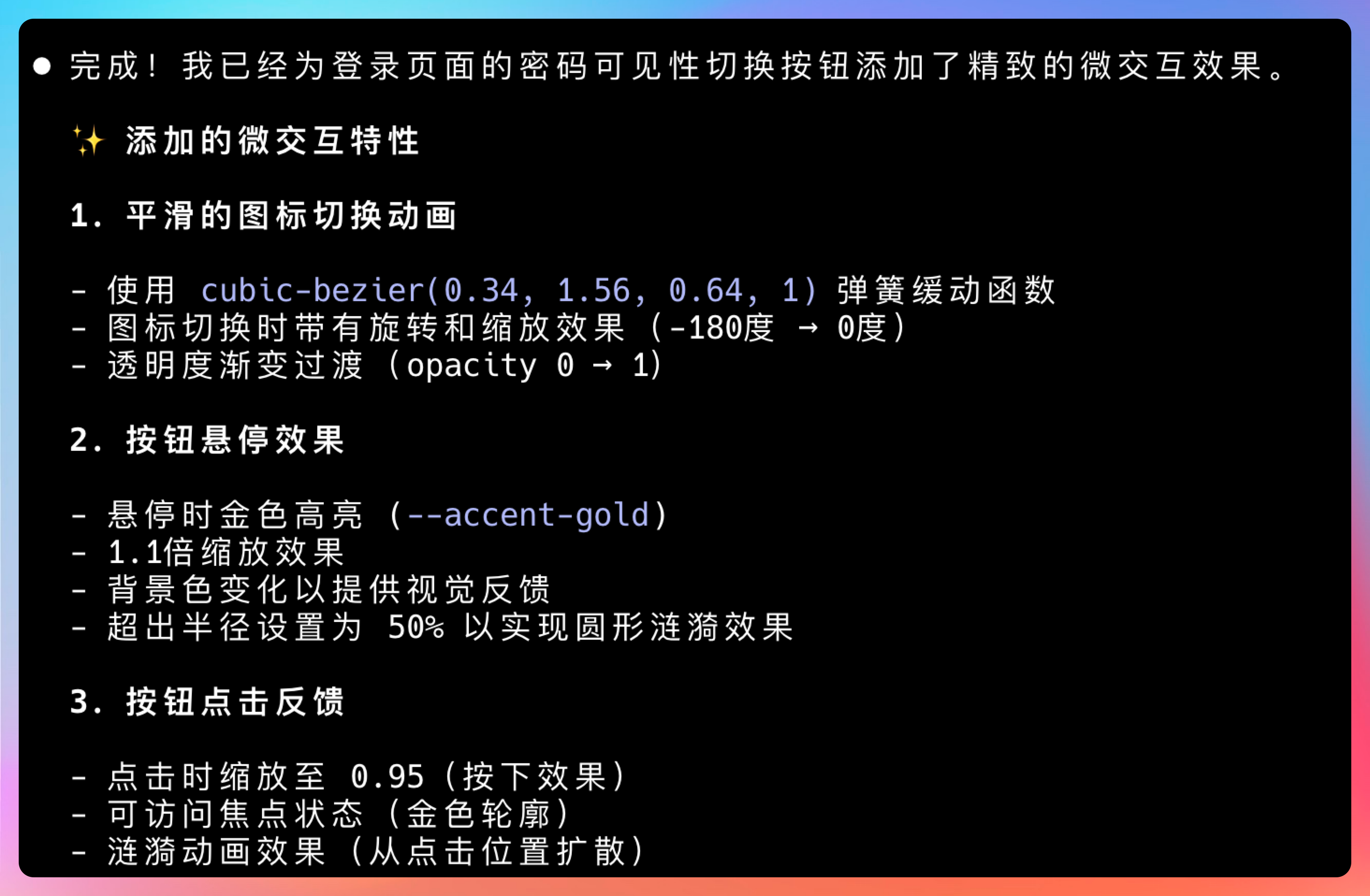

Interaction-design(前端交互设计)

下载地址:https://github.com/wshobson/agents/tree/main/plugins/ui-design/skills/interaction-design

这个 Skill 专注交互动效。微交互、状态反馈、过渡动画,是它的强项。

我让它给登录页加一个“密码可见性切换”的微交互。

输出包含:点击动效、图标切换动画、错误状态的抖动反馈。代码直接可用,动画参数也调得比较舒服。

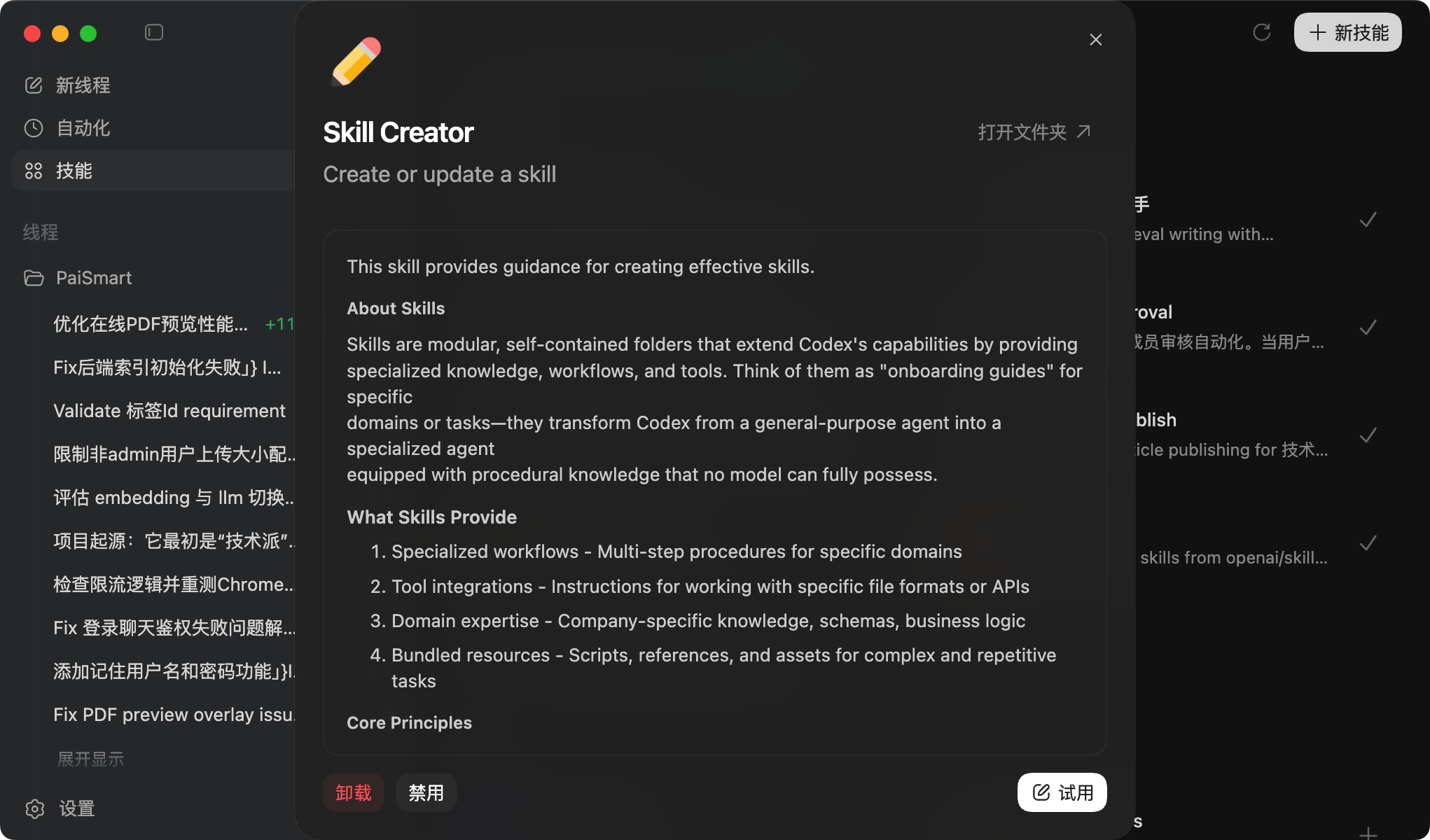

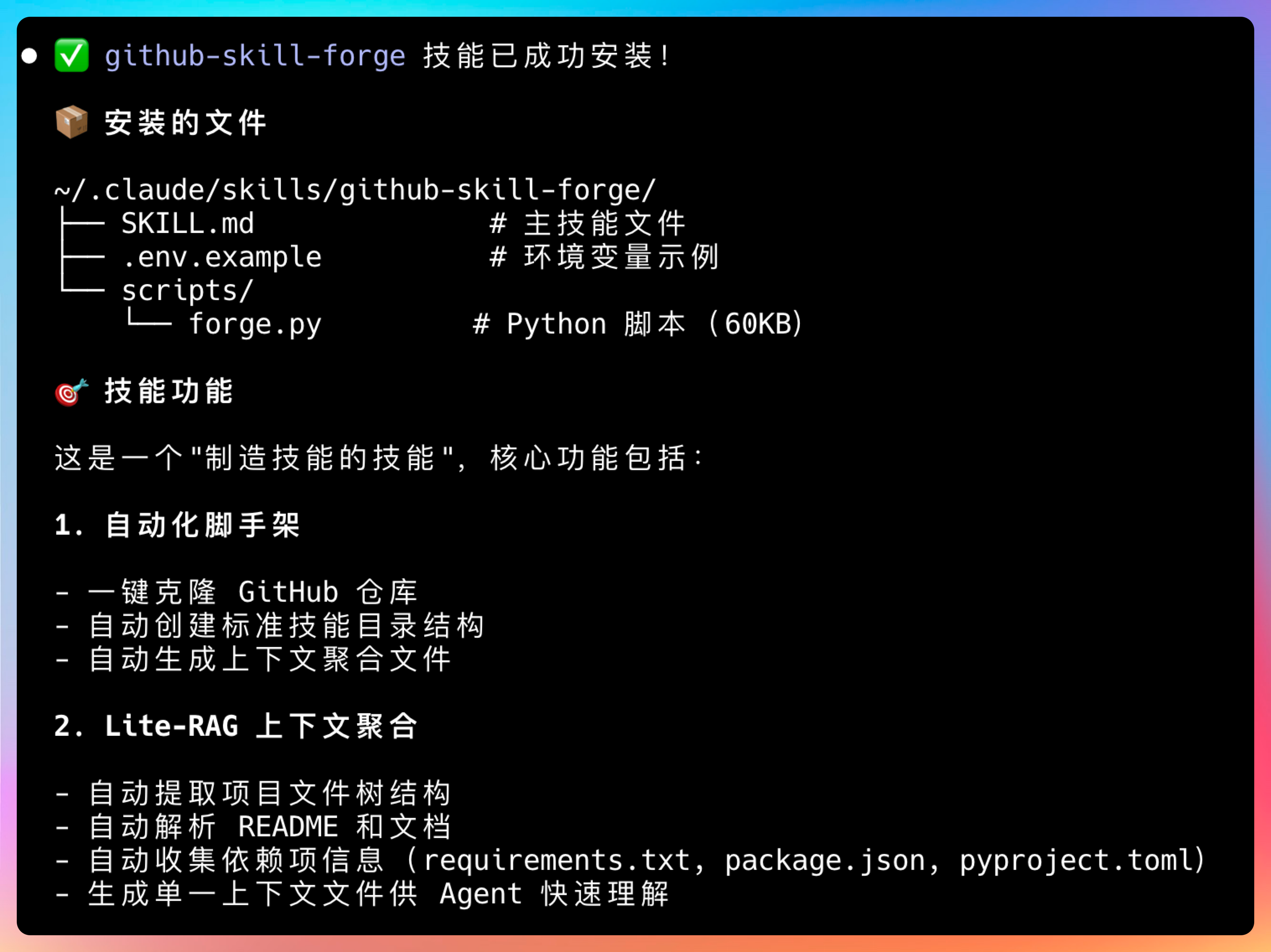

Skill-creator

下载地址:https://github.com/anthropics/skills/tree/main/skills/skill-creator

这个 Skill 是用来生成 Skills 的 Skill,有点绕,但很有用。

你把一个重复的工作流程描述给它,它帮你封装成可复用的 Skill。

Claude最近给这Skills做了较大的升级,新增完整的技能评估和基准测试框架。

- generate_review.py - 生成评估报告的脚本

- viewer.html - 交互式网页查看器,支持两个标签页,Outputs 标签 - 逐个查看测试用例的输出。提供反馈;Benchmark 标签 - 显示定量统计数据、通过率、时间和 token 使用

我也第一时间给Codex升级了,整体的使用体感感觉还不错。

对,Codex也可以用Claude的Skills。

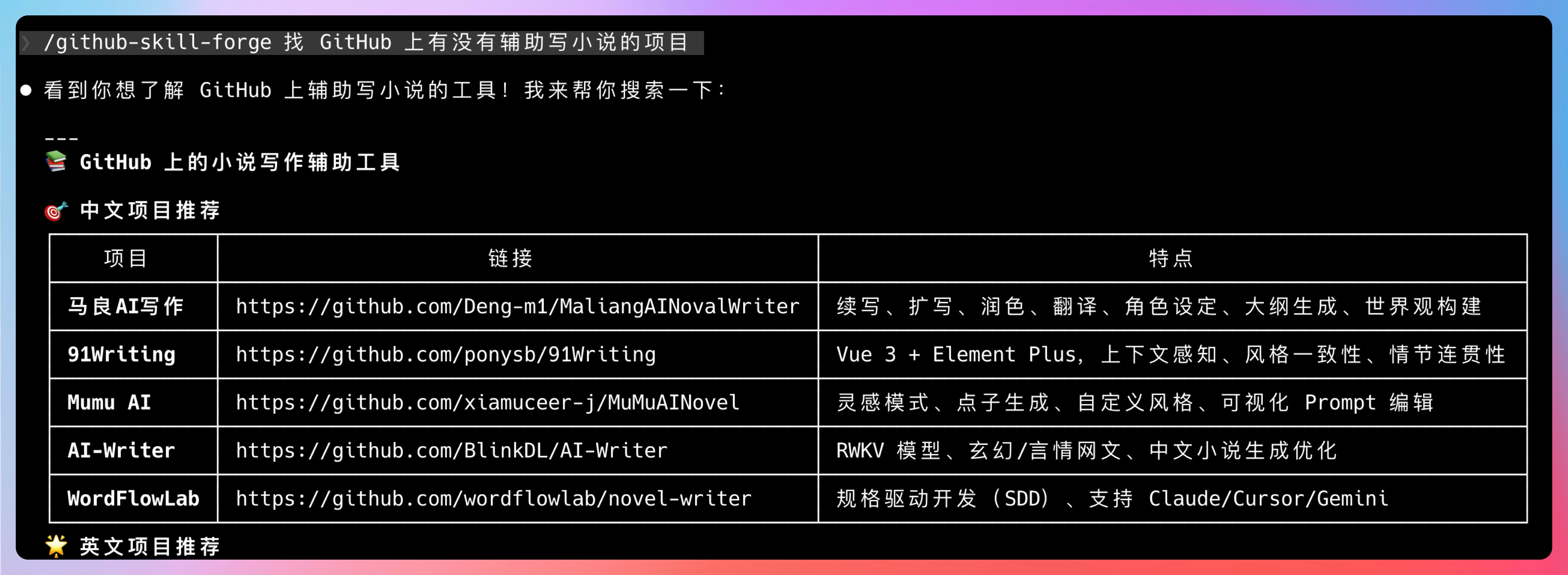

解决重复性信息检索的 Skill

这个 Skill 适合需要频繁查资料的场景。它会把你的检索流程固化下来,下次直接调用。

我让他找找 GitHub 上有没有辅助写小说的项目,他会先按照中英文做分类,然后把项目转换成Skills。

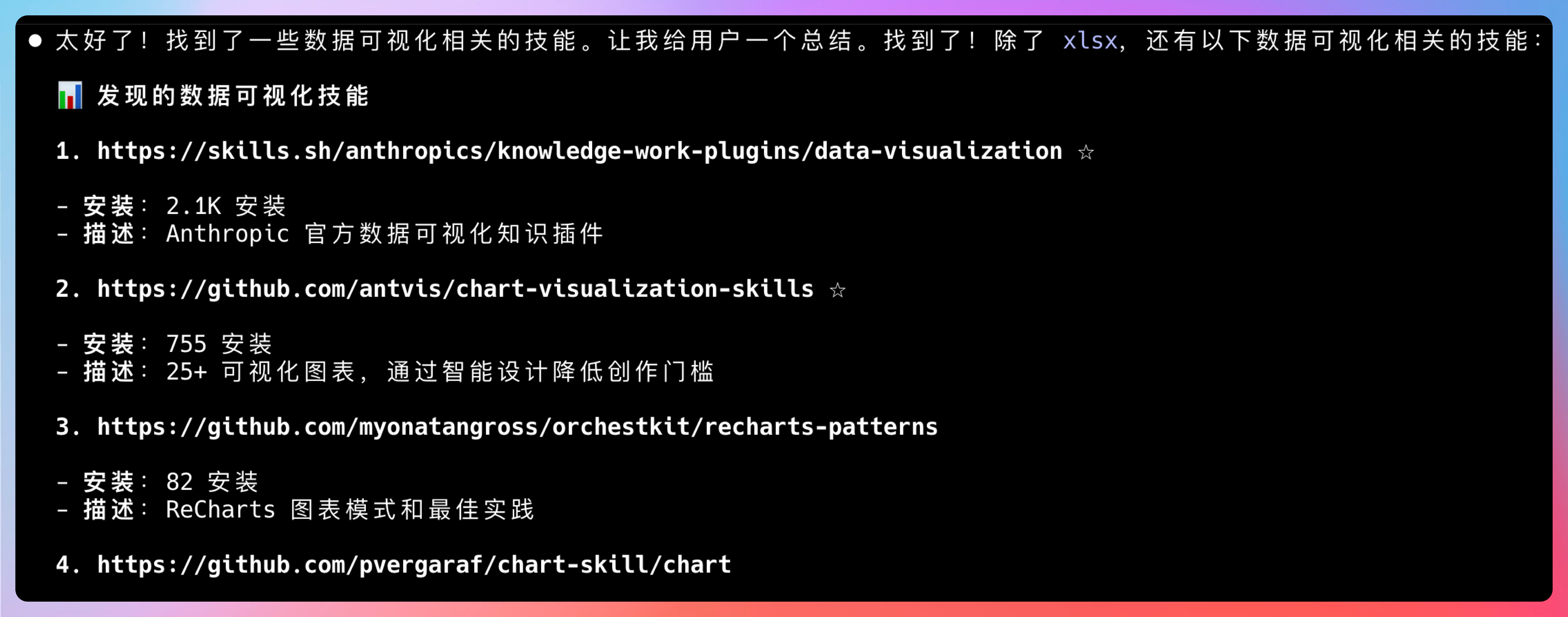

Find-Skills

这个 Skill 是用来发现其他 Skills 的。当你不知道某个需求该用哪个 Skill 时,它可以帮你推荐。

我测试问它:“我想生成一个数据可视化图表,该用哪个 Skill?”它推荐了 3 个相关 Skills,并说明了每个的适用场景。

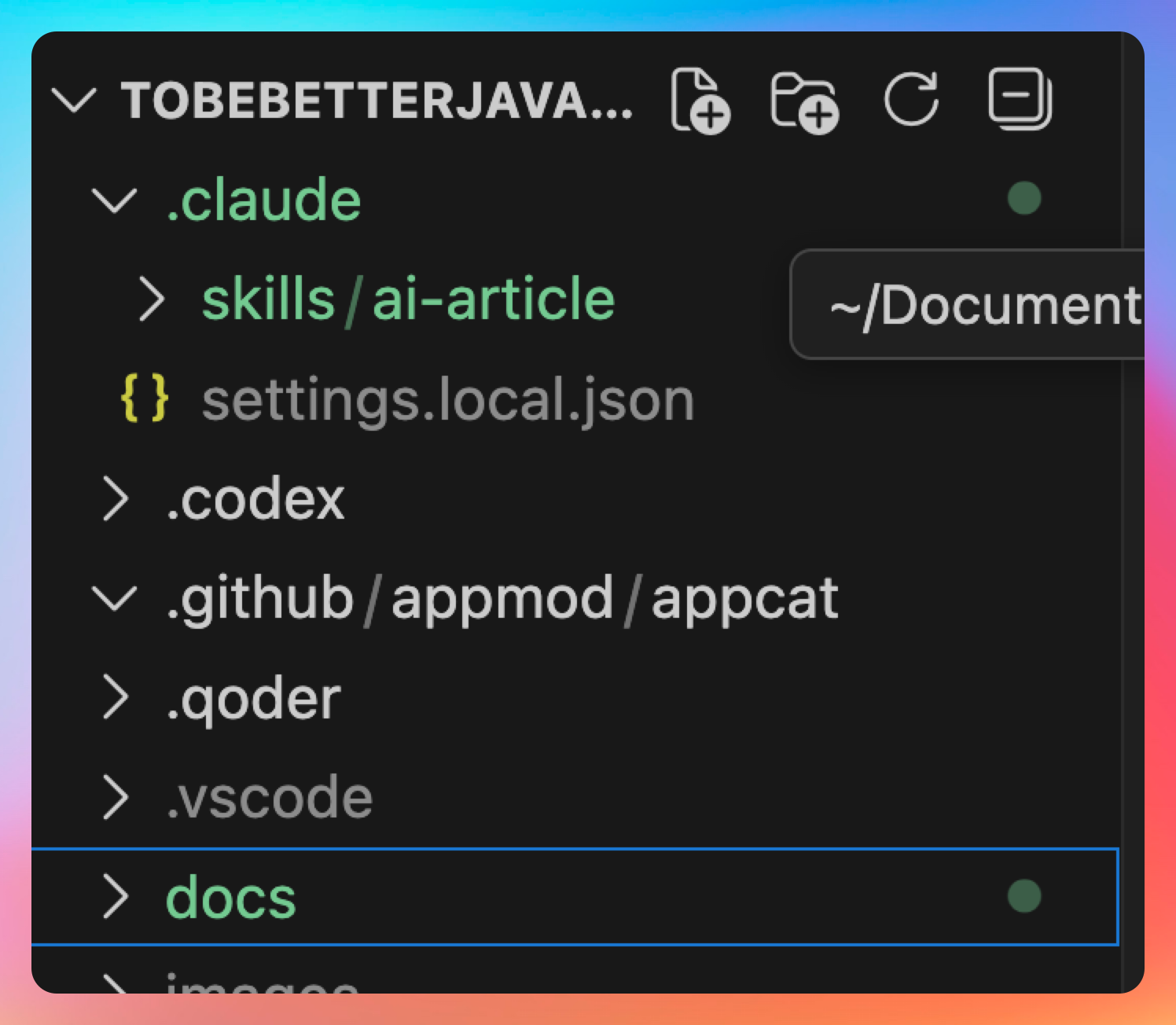

02、Skills 跨平台共享机制

这是很多人不知道的技巧:Skills 不是 Claude Code 独占的。

哪些工具支持 Skills

目前主流的支持 Skills 的 Agent 工具:

- **Claude Code:**原生支持,功能最全

- **Codex:**OpenAI 的 CLI 工具,兼容 Skills 格式

- **TRAE:**字节跳出的 AI IDE,支持 Skills 目录

- **Qoder:**阿里的 Agent 工具,同样兼容

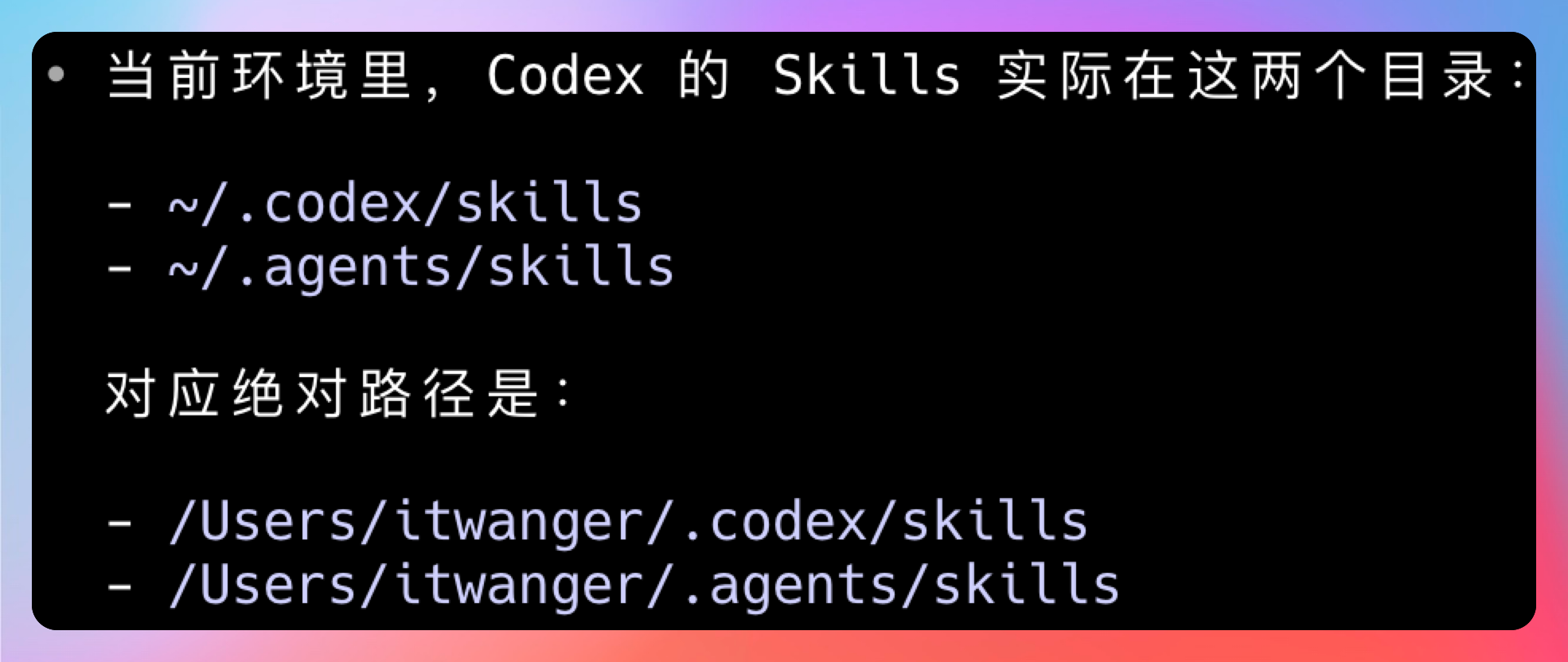

Skills 的目录位置

不同工具的 Skills 存放位置:

| 工具 | 个人 Skills 路径 | 项目 Skills 路径 |

|---|---|---|

| Claude Code | ~/.claude/skills/ |

.claude/skills/ |

| Codex | ~/.codex/skills/ |

.codex/skills/ |

| TRAE | ~/.trae/skills/ |

.trae/skills/ |

| Qoder | ~/.qoder/skills/ |

.qoder/skills/ |

这里要说明两点,除了 .codex 目录,Codex 还支持 .agent 目录;~ 是相对你的根目录,不带的话,相对你的项目目录。

一次配置,到处运行

Skills 的核心文件是SKILL.md,格式是统一的。这意味着:

- 你在 Claude Code 里写的 Skill,直接复制到 Codex 的 skills 目录就能用

- 项目级的 Skills(放在

.claude/skills/),改成.codex/skills/同样生效 - 甚至可以把 Skills 放在 Git 仓库里,团队共享

我实际测试过:把 Frontend-design 从 Claude Code 复制到 Qoder 的 skills 目录,重启后直接用/frontend-design就能调用,完全不用改代码。

这种兼容性来自于 Skills 的设计标准——它本质上是一个约定优于配置的规范:

- 目录名就是 Skill 名

- SKILL.md 是入口文件

- YAML Frontmatter 定义元数据

- Markdown 内容是执行指令

只要工具遵循这个规范,Skills 就能跨平台工作。

03、Skill-creator 的自动化原理

Skill-creator 为什么能自动生成 Skills?它的核心机制是什么?

先搞懂 SKILL.md 的结构

在讲自动化之前,我们先看一个完整的 SKILL.md 长什么样。

---

name: api-generator

description: 生成符合团队规范的 RESTful API 接口代码。当用户需要创建新的 API 接口时自动触发。

argument-hint: [模块名] [接口描述]

allowed-tools: Read, Write, Bash(npm *), Bash(pnpm *)

disable-model-invocation: false

---

## 任务目标

根据用户描述,生成符合团队规范的 RESTful API 接口代码。

## 执行步骤

1. **确认需求**:询问用户接口的用途、请求方式、参数要求

2. **定义路由**:按照 `/api/v1/{module}/{action}` 格式定义

3. **参数校验**:使用 Joi 或 Zod 定义请求参数校验规则

4. **业务逻辑**:编写 Service 层代码,处理核心业务

5. **错误处理**:统一返回格式 `{ code, message, data }`

6. **编写测试**:生成单元测试用例

## 输出规范

- Controller 层:只负责路由和参数校验

- Service 层:业务逻辑,不涉及 HTTP 相关

- 返回格式:统一使用 `ResponseUtil.success()` 和 `ResponseUtil.error()`

这个结构包含两部分:

YAML Frontmatter(元数据):

name:Skill 名称,也是调用时的命令(/api-generator)description:描述,Agent 用它来判断什么时候该调用这个 Skillargument-hint:参数提示,告诉用户该传什么参数allowed-tools:这个 Skill 可以使用的工具,避免每次都弹权限确认disable-model-invocation:是否禁止 Agent 自动调用,设为true只能手动触发

Markdown 内容(执行指令):

- 任务目标:一句话说明这个 Skill 干什么

- 执行步骤:Agent 会严格按照这个步骤走

- 输出规范:定义输出格式和约束

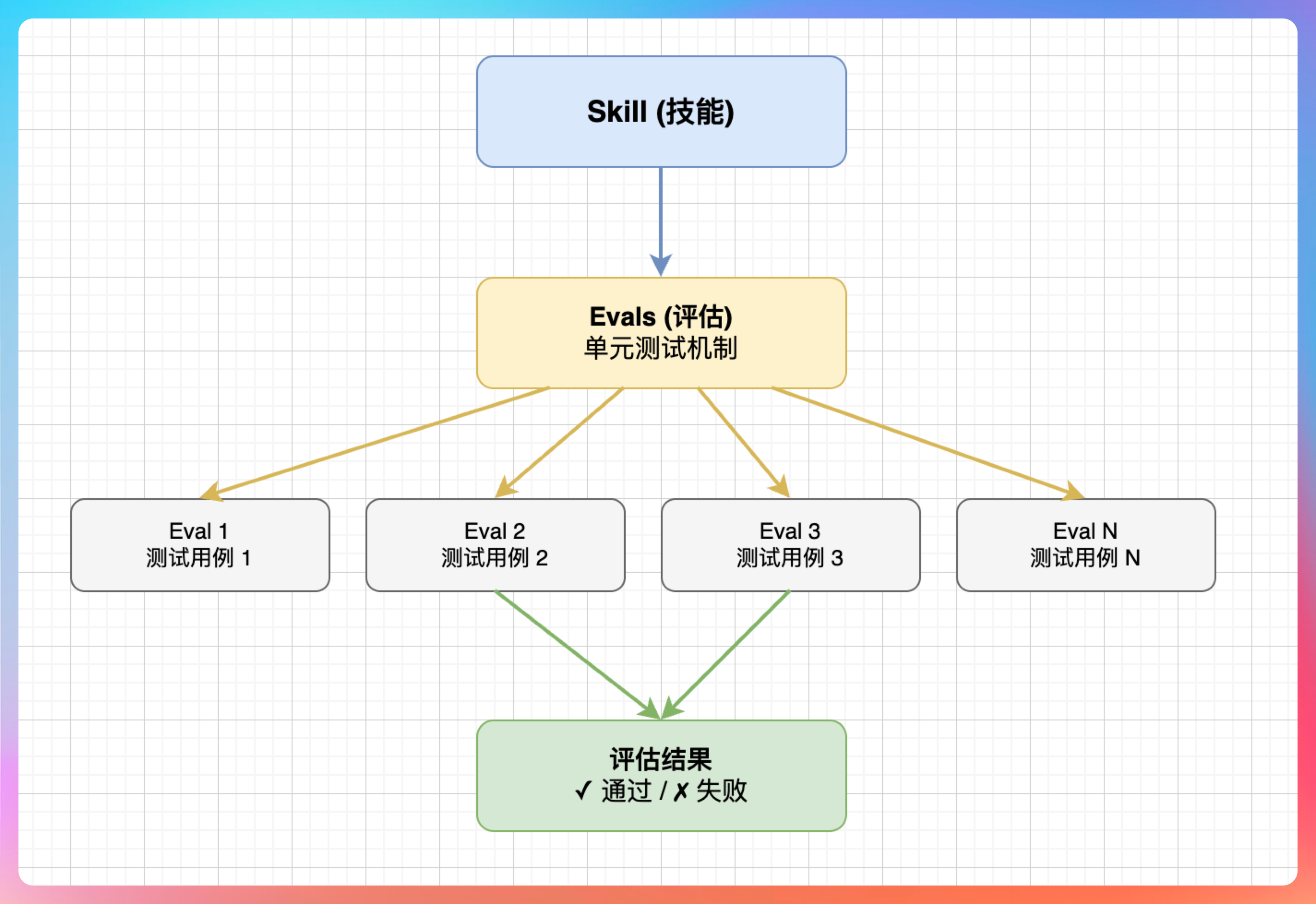

Evals 评估系统

Skill-creator 最新版本引入了 Evals(评估)机制。简单说,就是给 Skill 写“单元测试”。

你提供:

- 测试提示词(比如“生成一个用户注册表单的代码”)

- 预期结果的标准(比如“包含邮箱验证、密码强度提示”)

Skill-creator 会自动:

- 运行测试提示词

- 对比输出和预期标准

- 给出通过率和改进建议

完整的工作流程是这样的:

第一步:定义测试用例

你提供测试提示词和预期标准:

test_cases:

- prompt: "生成用户登录接口"

expected:

- 包含 POST /api/v1/auth/login 路由

- 包含邮箱和密码的参数校验

- 返回格式包含 token 字段

- 包含错误处理逻辑

第二步:自动运行测试

Skill-creator 会逐个运行测试提示词,收集 Skill 的输出结果,然后用另一个 LLM(评估器)对比输出和预期标准,生成评估报告。

第三步:生成评估报告

报告包含:通过率、失败原因、改进建议。这个评估报告可以通过 viewer.html 查看,支持交互式反馈。

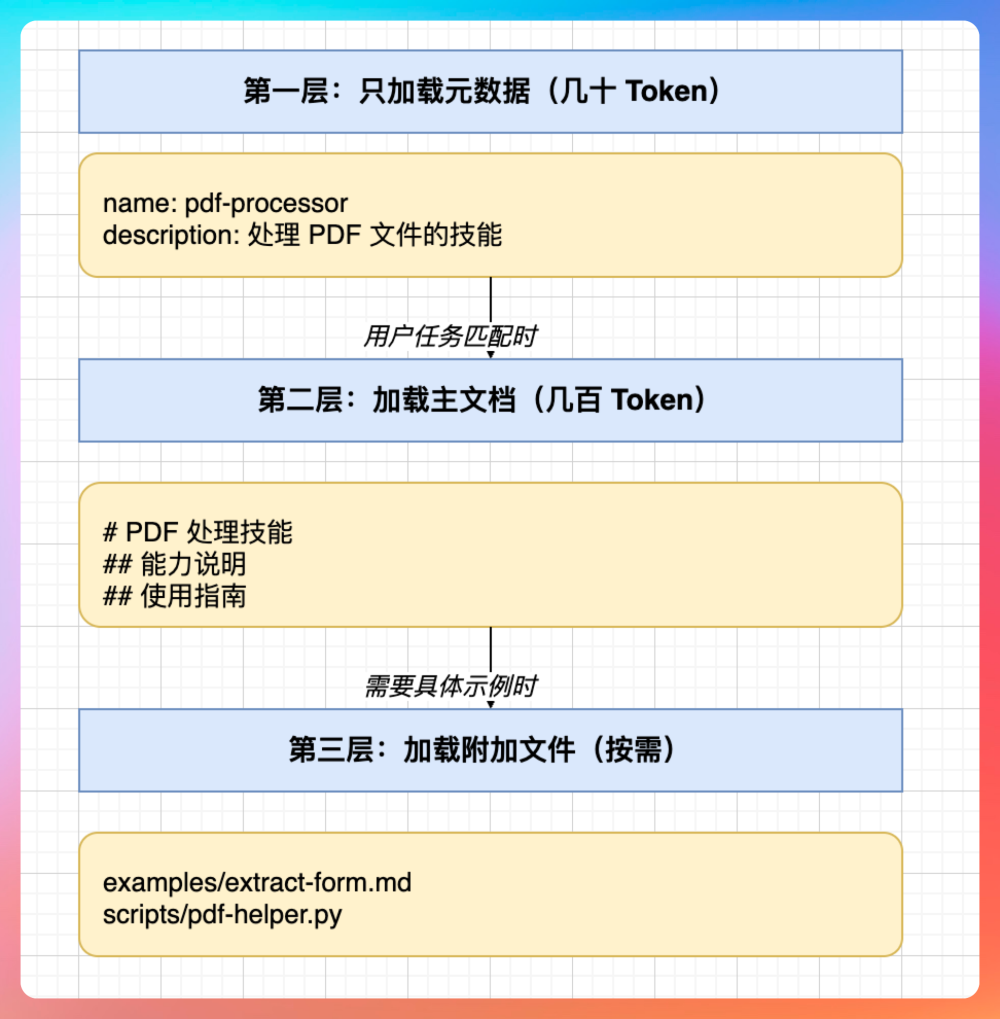

为什么 Skills 比 Prompt 强

很多人觉得 Skills 就是高级 Prompt,这个理解是错的。

Prompt 的问题:

- 每次都要重新描述:你让 Agent 写 API,第一次说了要参数校验、错误处理,下次忘了说,它就漏了

- 上下文污染:你的 Prompt 和对话混在一起,Agent 可能被之前的对话干扰

- 无法复用:你写了一个好的 Prompt,换个项目又要重新写一遍

Skills 的优势:

- 意图识别:Agent 启动时会扫描所有 Skills 的

description,当你的需求匹配时,自动加载对应的 Skill - 上下文隔离:Skill 内容作为隐藏元消息注入,不会和你的对话历史混淆

- 标准流程固化:SKILL.md 里的执行步骤,Agent 会严格遵守

- 跨平台复用:一次写好,Claude Code、Codex、Qoder 都能用

为什么能让 Agent“变聪明”

传统的 Prompt 是“一次性”的,每次都要从头描述需求。Skills 把“如何完成某类任务”固化了:

- 意图识别:通过

description字段,Agent 知道什么时候该调用这个 Skill - 标准流程:SKILL.md 里定义了执行步骤,Agent 按步骤走,不会漏

- 上下文管理:Skill 只在匹配时加载,不占用常驻上下文

举个例子:没有 Skill 时,你让 Agent“写一个 API 接口”,它可能漏掉参数校验、错误处理。有了 Skill,它按 Skill 定义的步骤走:定义路由 → 参数校验 → 业务逻辑 → 错误处理 → 返回格式,一步都不会少。

适合自动化的场景

Skill-creator 最适合这几类场景:

- 重复的工作流:每次都要走同样的步骤,比如“查资料 → 整理 → 输出报告”

- 有明确标准的任务:代码审查、文档生成、测试用例编写

- 团队协作规范:把团队的 Best Practice 固化成 Skill,新人直接用

不适合的场景:

- 一次性、探索性的任务

- 需要大量创意和变通的工作

04、如何写到简历上

折腾了这么多 Skills,怎么体现到简历里?

错误写法

“熟练使用 Claude Code Skills”

这种写法太虚,HR 看不懂,面试官也不知道你到底是什么水平。

正确写法

要具体、量化、有场景。

项目描述示例:

基于 Claude Code Skills 构建团队前端开发工作流,封装 6 个标准化 Skills(页面生成、交互设计、代码审查、文档生成等),覆盖 80%日常开发场景,新人上手时间从 3 天缩短到 2 小时。

面试时怎么聊

如果被问到“你用 Skills 做了什么”,按这个结构答:

- 背景:团队/个人面临什么问题(重复工作、规范不统一、新人培训成本高)

- 方案:用 Skills 封装了哪些能力,为什么选择这些 Skill

- 效果:量化结果(时间节省、错误率降低、团队效率提升)

- 延伸:跨平台共享机制、Evals 评估、持续优化流程

不同岗位的写法差异

前端开发:

封装 Frontend-design 和 Interaction-design 两个 Skills,将 UI 设计稿转代码的时间从平均 4 小时缩短到 30 分钟,输出代码符合团队规范,可直接进入 Code Review。

后端开发:

基于 Skill-creator 构建代码审查 Skill,自动检测 Java 代码的命名规范、异常处理、SQL 注入风险,团队代码问题检出率提升 40%,Code Review 时间减少 60%。

技术负责人:

搭建团队 Skills 体系,封装 10+ 个标准化工作流(API 生成、文档输出、测试用例编写),新人上手时间从 2 周缩短到 3 天,团队整体开发效率提升 35%。

面试官会追问什么

问题一:Skills 和 Prompt 有什么区别?

这个问题我在 03 章节详细讲过,核心回答:

Skills 是结构化的、可复用的、带评估机制的能力包。Prompt 是一次性的指令。Skills 的优势在于意图识别、上下文隔离、标准流程固化、跨平台复用。

问题二:你们团队是怎么推广 Skills 的?

先从最痛的痛点入手。我们团队之前 Code Review 花费大量时间,我就先封装了一个代码审查 Skill,让大家尝到甜头。然后逐步扩展到 API 生成、文档输出等场景。关键是让团队成员感受到效率提升,而不是强制推广。

问题三:Skills 的维护成本高吗?

初期投入确实需要时间,但长期来看是值得的。我们用 Evals 评估系统,每次修改 Skill 后自动跑测试,确保不退化。一个成熟的 Skill,维护成本大概每周 1-2 小时,但节省的时间是几十小时级别的。

问题四:有没有遇到什么坑?

有。最大的坑是 Skills 的 description 写得太宽泛,导致 Agent 在不该调用的时候也调用了。后来我们学会了用

disable-model-invocation: true控制触发时机,只允许手动调用。另一个坑是 Skills 之间可能冲突,比如 Frontend-design 和 UI-UX-PRO-MAX 同时存在时,Agent 不知道该用哪个。解决方案是在 description 里明确适用场景。

ending

折腾 Skills 这段时间,我有一个很深的感受:AI 工具的发展速度,远超我们的预期。

Skills 把个人的经验、团队的规范、行业的 Best Practice,固化成可复用的能力包。

更重要的是,Skills 不是某个工具的独占功能。

从 Claude Code 到 Codex,从 TRAE 到 Qoder,大家都在拥抱这个标准。这意味着你今天写的 Skill,明天可能在另一个工具里继续创造价值。

【Skills 的本质,是把“经验”变成“基础设施”。】

以前,一个老程序员的宝贵经验,只能通过带新人、写文档、代码审查来传递。现在,你可以把它封装成 Skill,整个团队都能用,而且用法完全一致。

有问题评论区见,我们下期聊!

回复