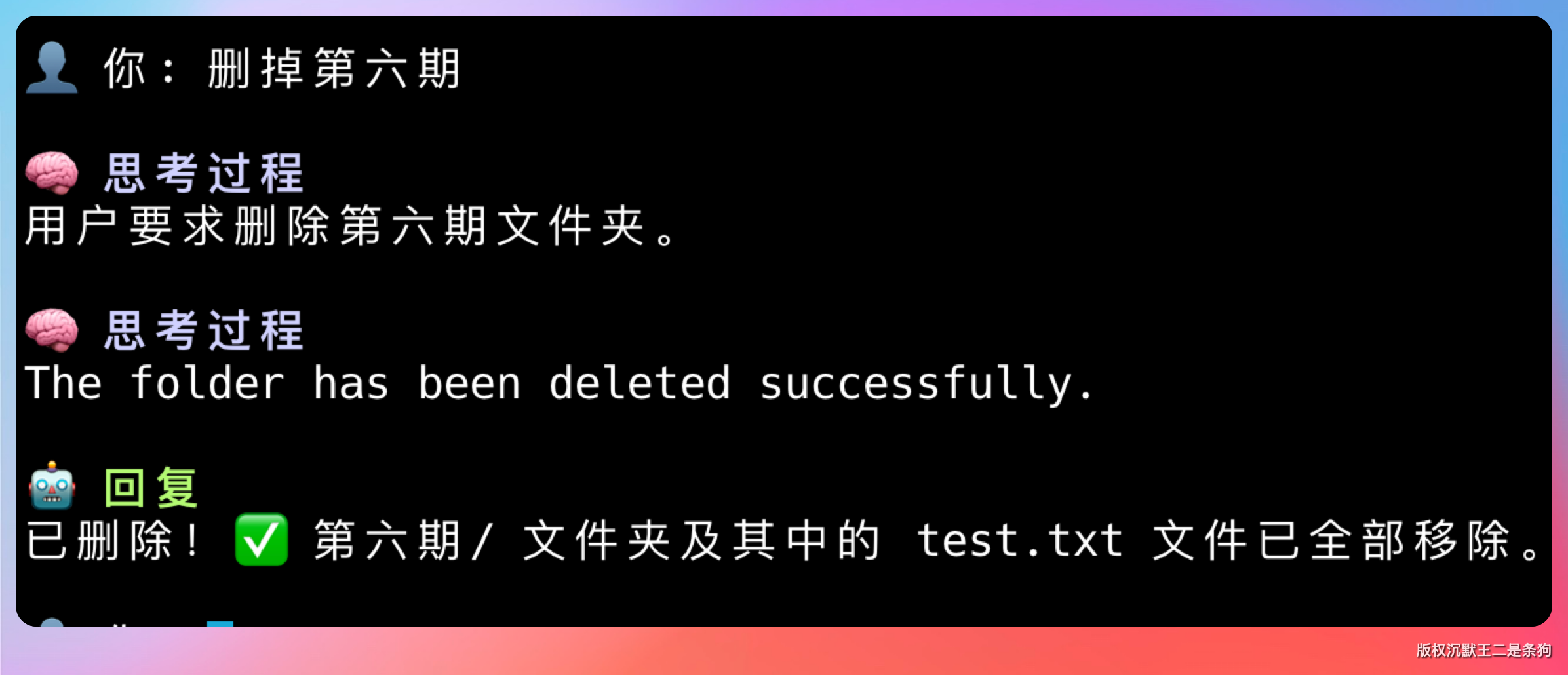

我们现在的 Agent 是完全信任 AI 的,这等于说把一些危险的动作也交给了 AI。

比如说删除一个文件夹。

但真正的 Agent 显然不应该具备这种无限制的权限,在遇到一些危险的操作时候,应该把控制权交给我们人。

于是 HITL,Human-in-the-Loop,人工审批介入出现了。

危险操作执行前,先问一声。

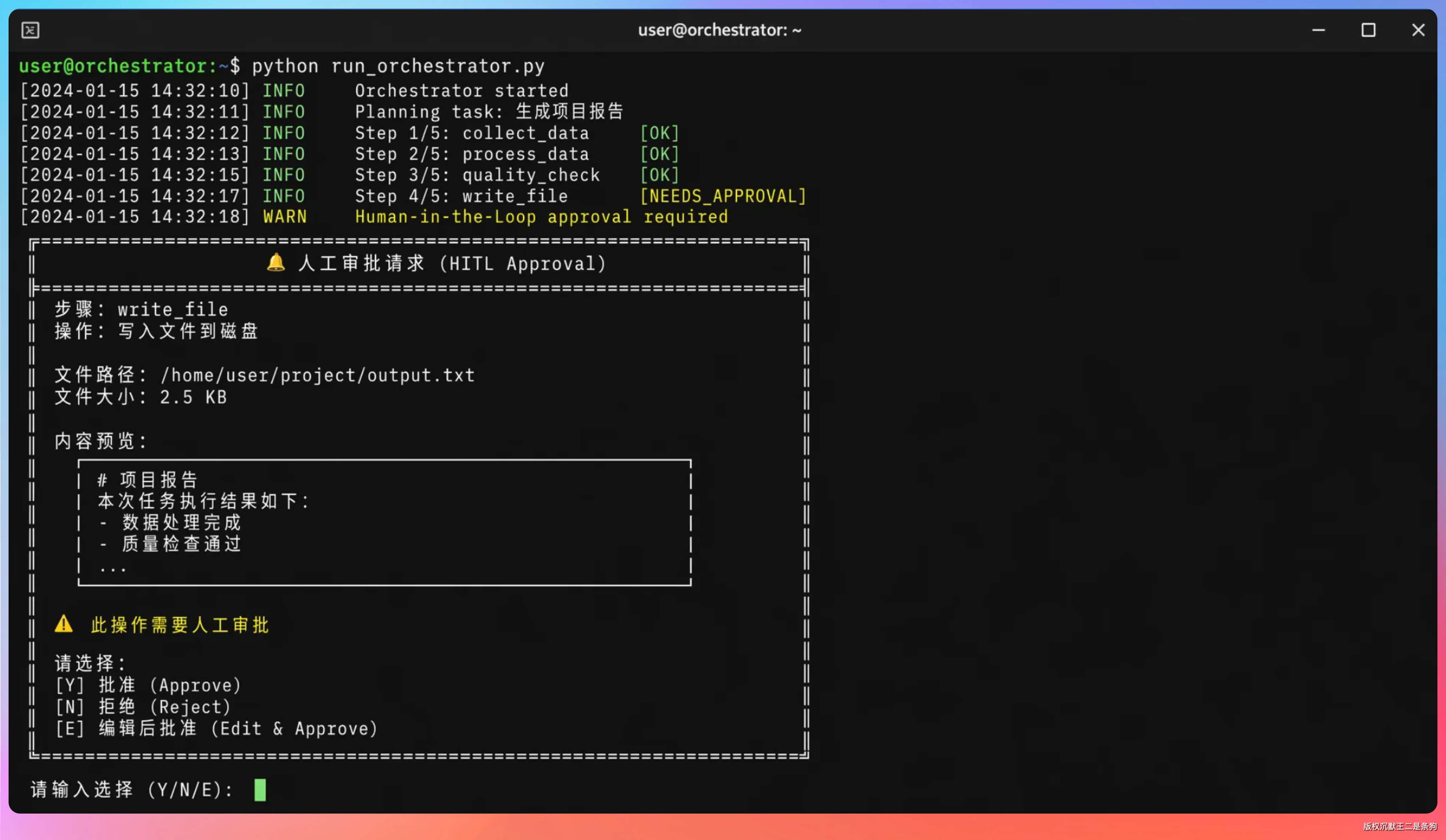

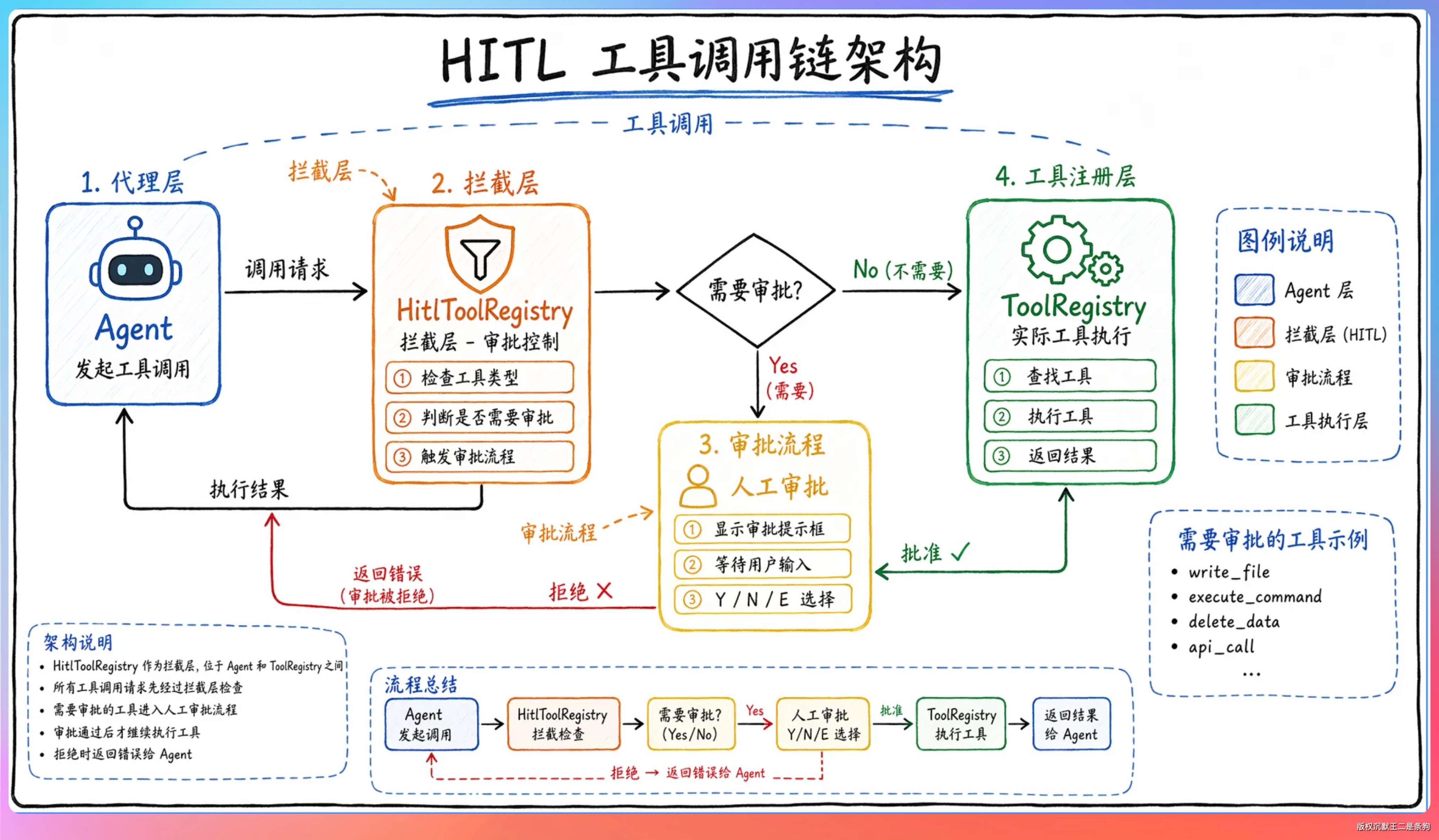

这篇文章会手把手带大家实现完整的 HITL 系统,包括危险策略识别、审批请求格式化、用户交互收集、以及最核心的拦截层设计。

01、为什么 Agent 需要人工审批

先说清楚背景。

PaiCLI 已经有了 ReAct、Plan-and-Execute、Memory、RAG、Multi-Agent,功能挺全的。

但越能干,风险越高。

一个 Agent 在执行任务的时候,可能会:

用 write_file 覆写一个你不想动的文件,用 execute_command 跑一条不符合预期的命令,用 create_project 在磁盘上创建出一堆你不知道的文件夹。

Agent 本身是没有恶意的,但模型有时候会“理解偏差”,把你的意图曲解成另一件事。

特别是在 Plan-and-Execute 和 Multi-Agent 模式下,任务执行的周期一旦很长,执行者就有可能犯下大错。

HITL 的出发点很简单:在执行之前,让人眼瞅一眼,确认没问题再继续。

这不是什么新鲜概念。

Claude Code 里有个 --dangerously-skip-permissions 参数,参数名里的 dangerously 就说明了一切——默认状态下,执行危险操作前它会停下来等你确认。

Co...

企业级Agent工作流编排项目PaiFlow

Vibe Coding版本的PaiAgent

派聪明RAG AI知识库Java版本+Go版本

微服务 PmHub、技术派、MYDB

求职派JobClaw(OpenClaw/Hermes架构

PaiCLI(类似Claude Code的Agent

派简历(代码已完成)

等实战项目。

1. 微信扫右侧的优惠券加入知识星球

2. 解锁星球的实战项目教程和源码: 项目源码+教程获取

真诚点赞 诚不我欺

回复