如何将技术派写到简历上?提供超过 200 种写法,附30道高频面试题,覆盖 web项目的方方面面

大家好呀,我是技术派的导演二哥呀。

之前有球友反馈自己的项目经历太少,不好写简历,影响找工作,不知道你有没有这样的困惑?

如果有,那这篇文章将完美解决你的痛点。

一共三大块。

第一块,技术派在面试中都会遇到哪些问题,并且该如何回答,有完美的模板套路。

第二块,校招生在写简历的时候,应该怎么写,可以直接抄,但尽量自己稍微动动脑子优化一下。

第三块,社招党在把技术派写到简历的时候,应该怎么写,有哪些考察的点需要注意。

如果你还没有加入二哥的编程星球,那么可以扫下面这个优惠券加入,不贵,但真的能帮你拿到心仪的 offer。

扫码加入知识星球即可解锁。

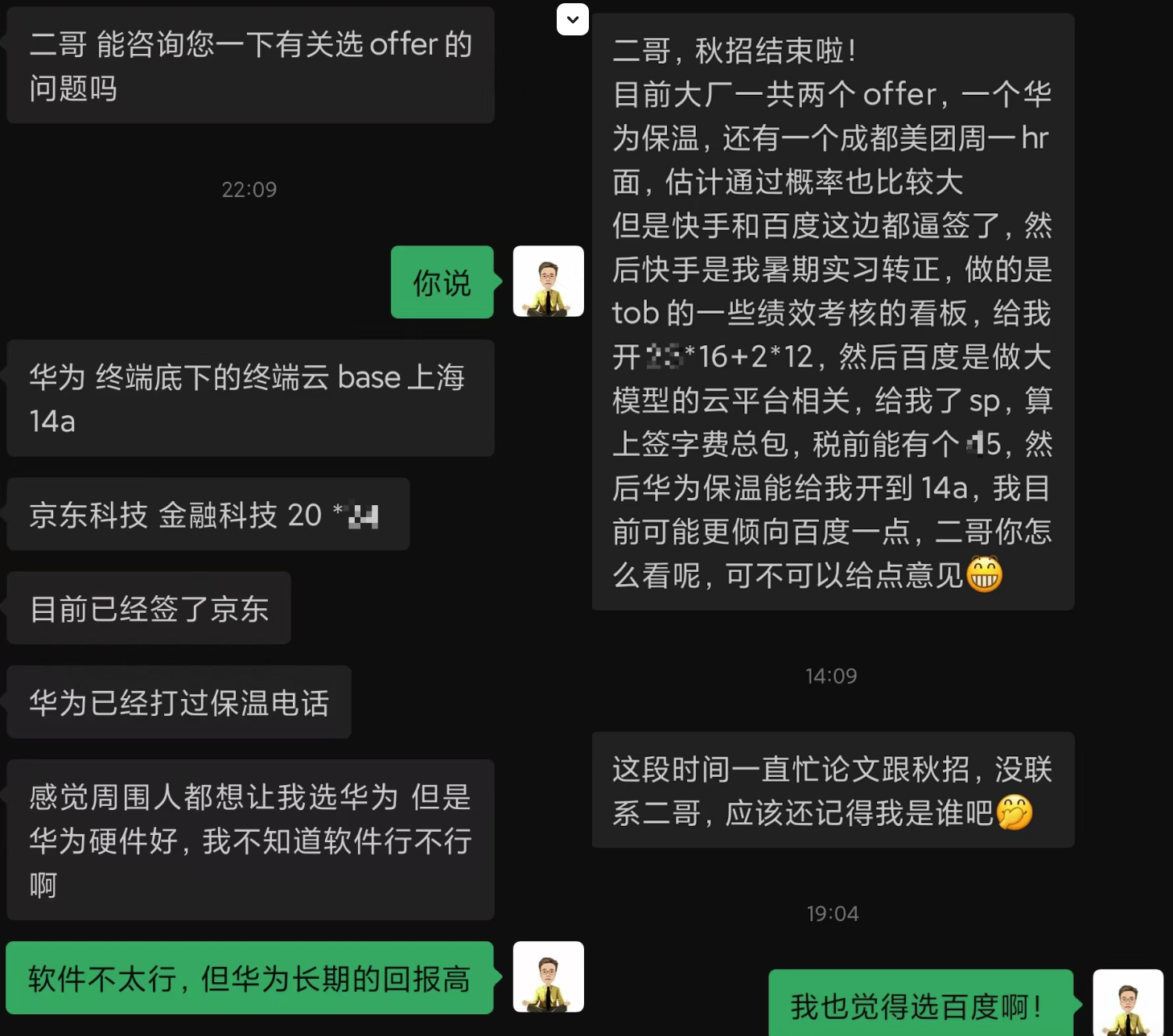

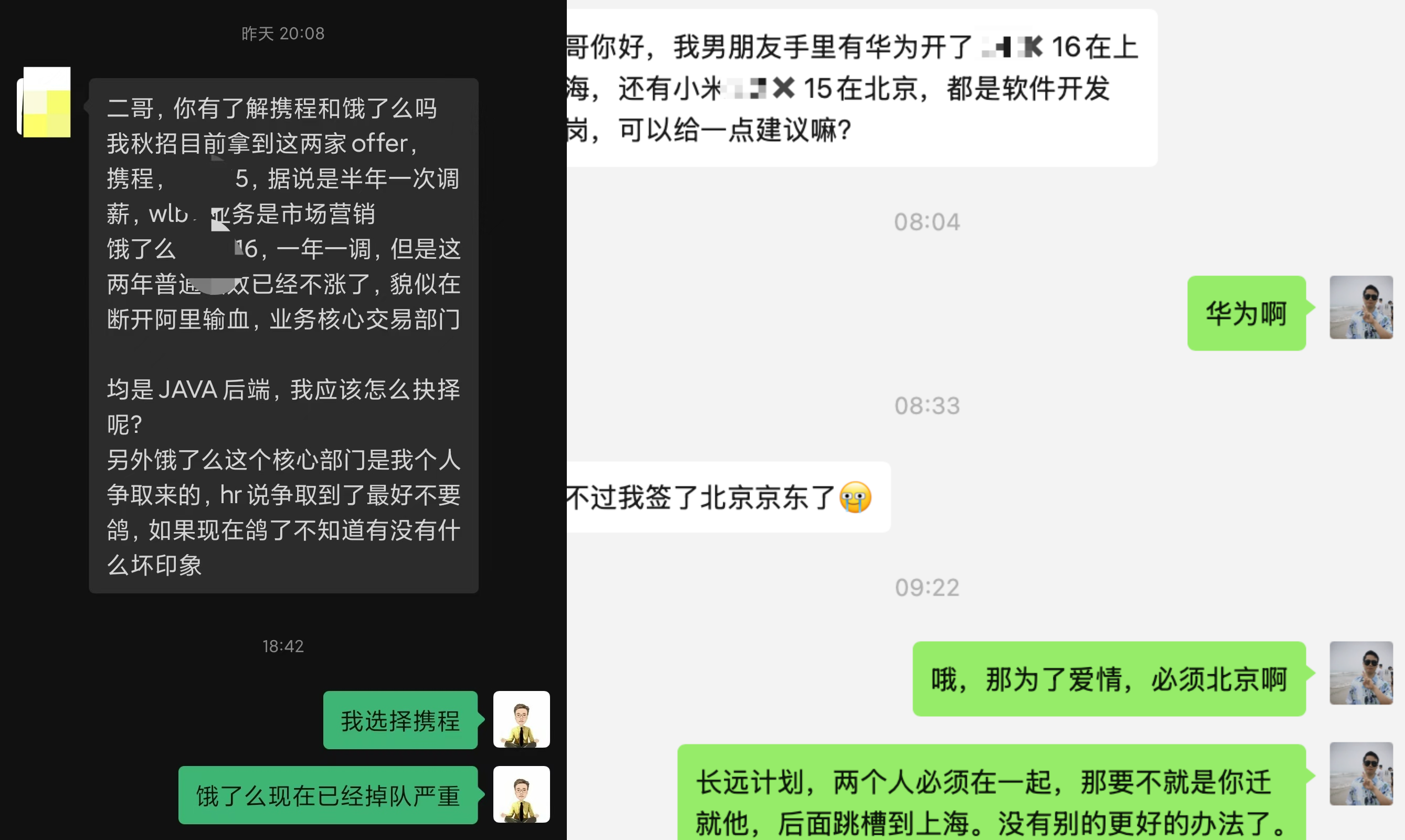

补充一些 25 届同学的 offer 截图,这些都是星球里的球友,他们的成功经历也是星球的成功(我骄傲了吗?嗯,骄傲了🤣)。

华为和京东、快手、百度、华为:

滴滴和百度、字节sp、美团、腾讯和京东、蚂蚁金服:

携程和饿了么、男朋友华为小米,自己京东:

太多太多,我就不一一列了。

记住一点,早就是优势,大家可以看一下这位球友的心路历程,是真的后悔没有早一点入,享受更多的优惠和更早的服务。

好,我们来进入重点。

1.1 核心面试点

- 其他考点1:https://t.zsxq.com/3yPsJ

- 考点 2:https://t.zsxq.com/eLDQ7

- 技术派拿到阿里云暑期实习的总结https://t...

已加入星球,可直接知识星球授权登录

二哥编程星球目前包含:

企业级Agent工作流编排项目PaiFlow

Vibe Coding版本的PaiAgent

派聪明RAG AI知识库Java版本+Go版本

微服务 PmHub、技术派、MYDB

求职派JobClaw(OpenClaw/Hermes架构

PaiCLI(类似Claude Code的Agent

派简历(代码已完成)

等实战项目。

企业级Agent工作流编排项目PaiFlow

Vibe Coding版本的PaiAgent

派聪明RAG AI知识库Java版本+Go版本

微服务 PmHub、技术派、MYDB

求职派JobClaw(OpenClaw/Hermes架构

PaiCLI(类似Claude Code的Agent

派简历(代码已完成)

等实战项目。

1. 微信扫右侧的优惠券加入知识星球

2. 解锁星球的实战项目教程和源码: 项目源码+教程获取

热门评论

58 条评论

回复