大家好,我是二哥呀。

不管是 Claude Code 还是 Codex,它们在读项目源码/读知识库的时候都很无敌,随便问一个问题,都能精准定位到对应的代码块/文档。

这是怎么做到的呢?

背后离不开 Embedding 的功劳。

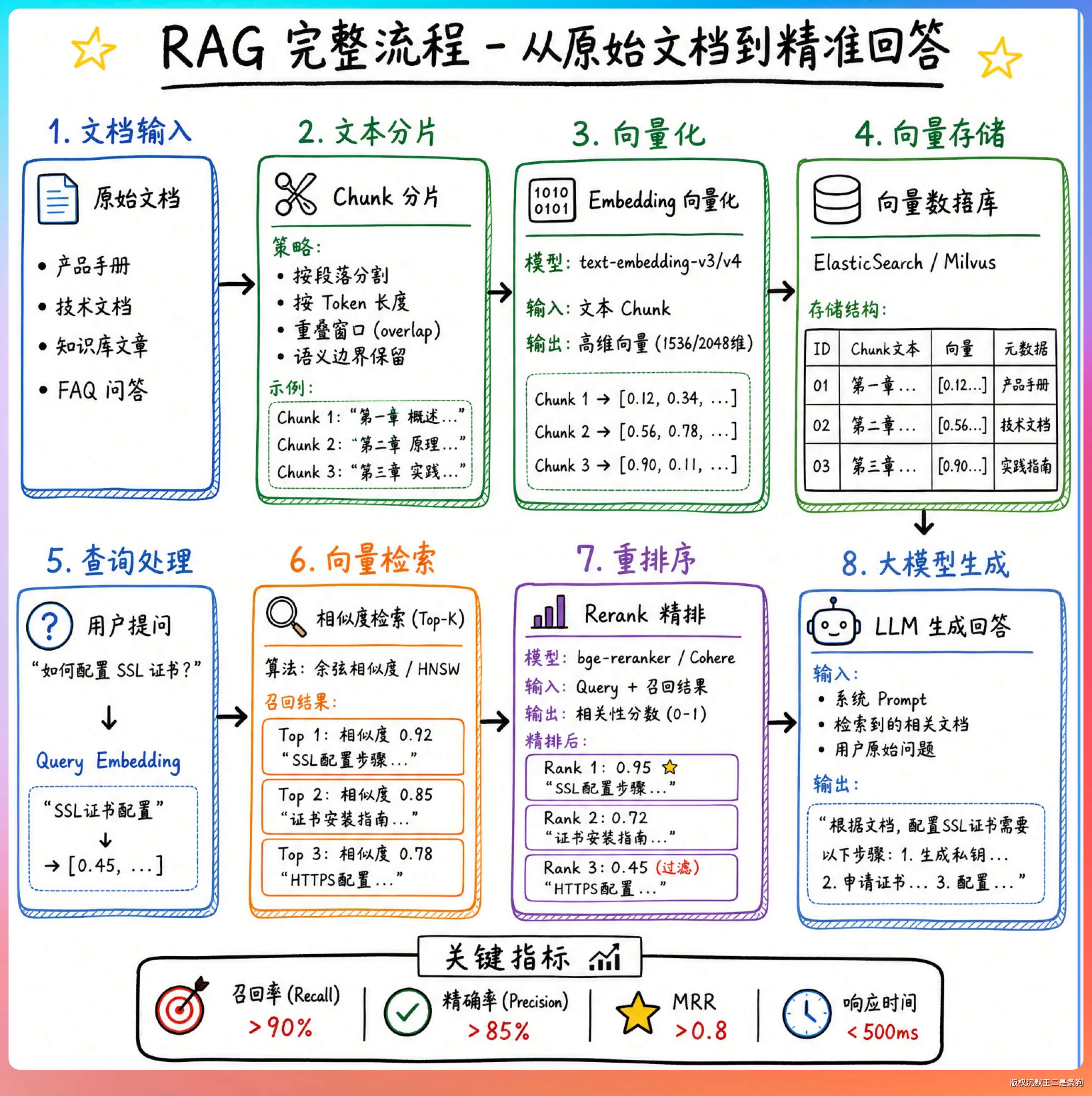

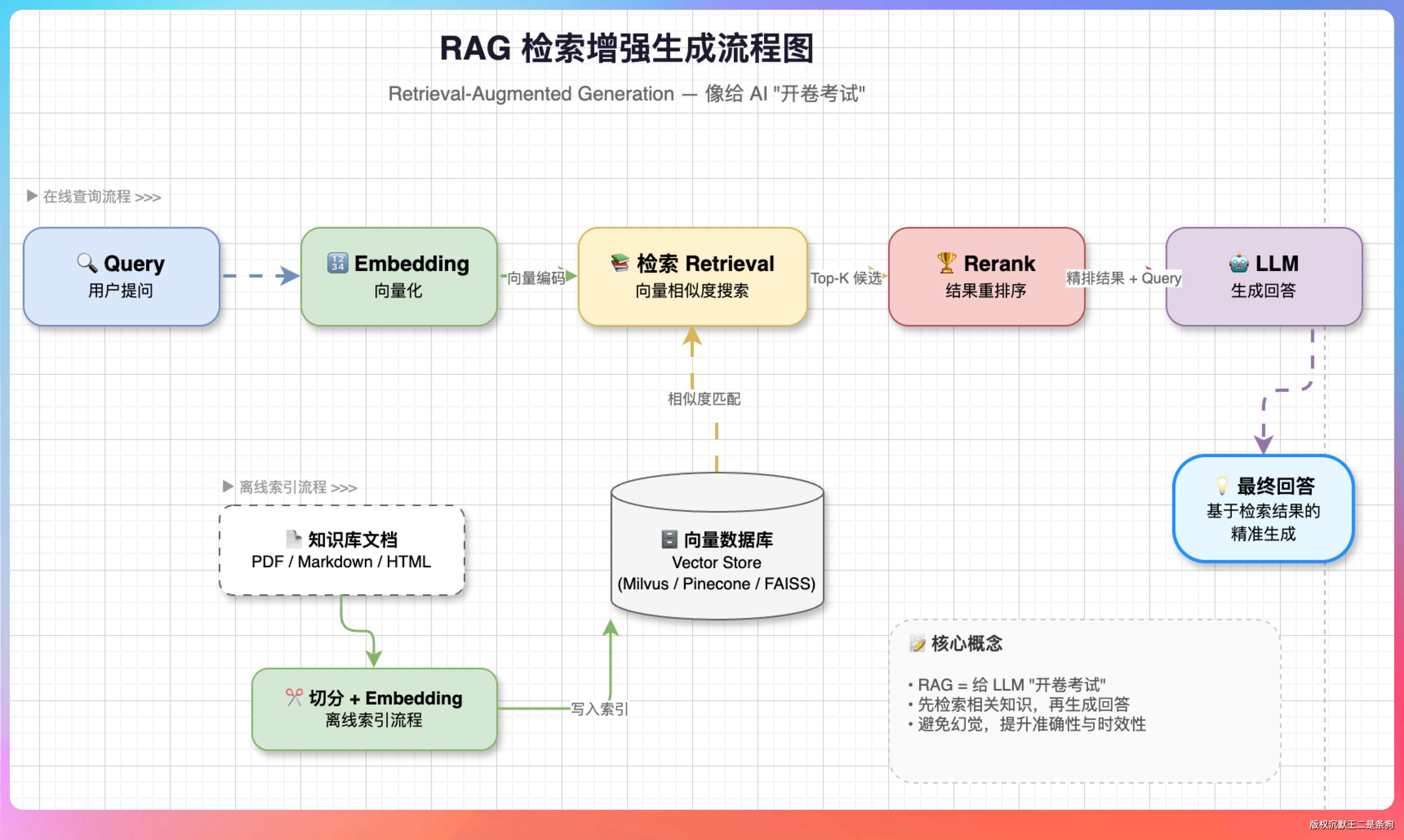

今天这篇,我们从 Embedding 和 Rerank 的原理讲起,结合派聪明 RAG 和 PaiCLI Agent 两个项目的真实实现,把这两块知识彻底讲透。

01、为什么需要 RAG?

现在的模型能力已经非常强了,不管是 GPT-5.5 还是 Opus 4.7。

基本上日常的 Coding 和部分的文本都可以交给他们来完成了。

并且质量很高。

但有两个问题是 LLM 很难解决的。

第一个是知识截止。

模型训练完之后,它的知识就定格在那个时间点了。2026 年 5 月发生的事,一个 2025 年训练完的模型是不可能知道的。

第二个是私有数据盲区。

公司内部的文档、代码仓库、客户资料,这些没出现在训练数据里的东西,模型统统不认识。

解决办法目前有两个,一个是联网搜索,让 Agent 即时获取最新的知识。

另外一个就是 RAG。思路很简单:问问题之前,先从知识库里把相关的内容检索出来,塞到 LLM 的上下文里,让它"开卷考试"。

这个检索过程的核心技术就是 Embedding。

02、Embedding 是什么?

Embedding 就是把文本变成一组向量,让计算机能用数学方式理解语义。

举个例子,王二是个沙雕和王二很可能不正常,在语义上是完全一样的。

Embedding 做的就是这件事,把这两句话各自变成一个 2048 维的向量(一组 2048 ...

企业级Agent工作流编排项目PaiFlow

Vibe Coding版本的PaiAgent

派聪明RAG AI知识库Java版本+Go版本

微服务 PmHub、技术派、MYDB

求职派JobClaw(OpenClaw/Hermes架构

PaiCLI(类似Claude Code的Agent

派简历(代码已完成)

等实战项目。

1. 微信扫右侧的优惠券加入知识星球

2. 解锁星球的实战项目教程和源码: 项目源码+教程获取

真诚点赞 诚不我欺

回复